ChatGPTを使い始めて約1年経ちましたが、頑なにカスタム指示を使わなかった私が、ついに指示文章を入れることにしました。

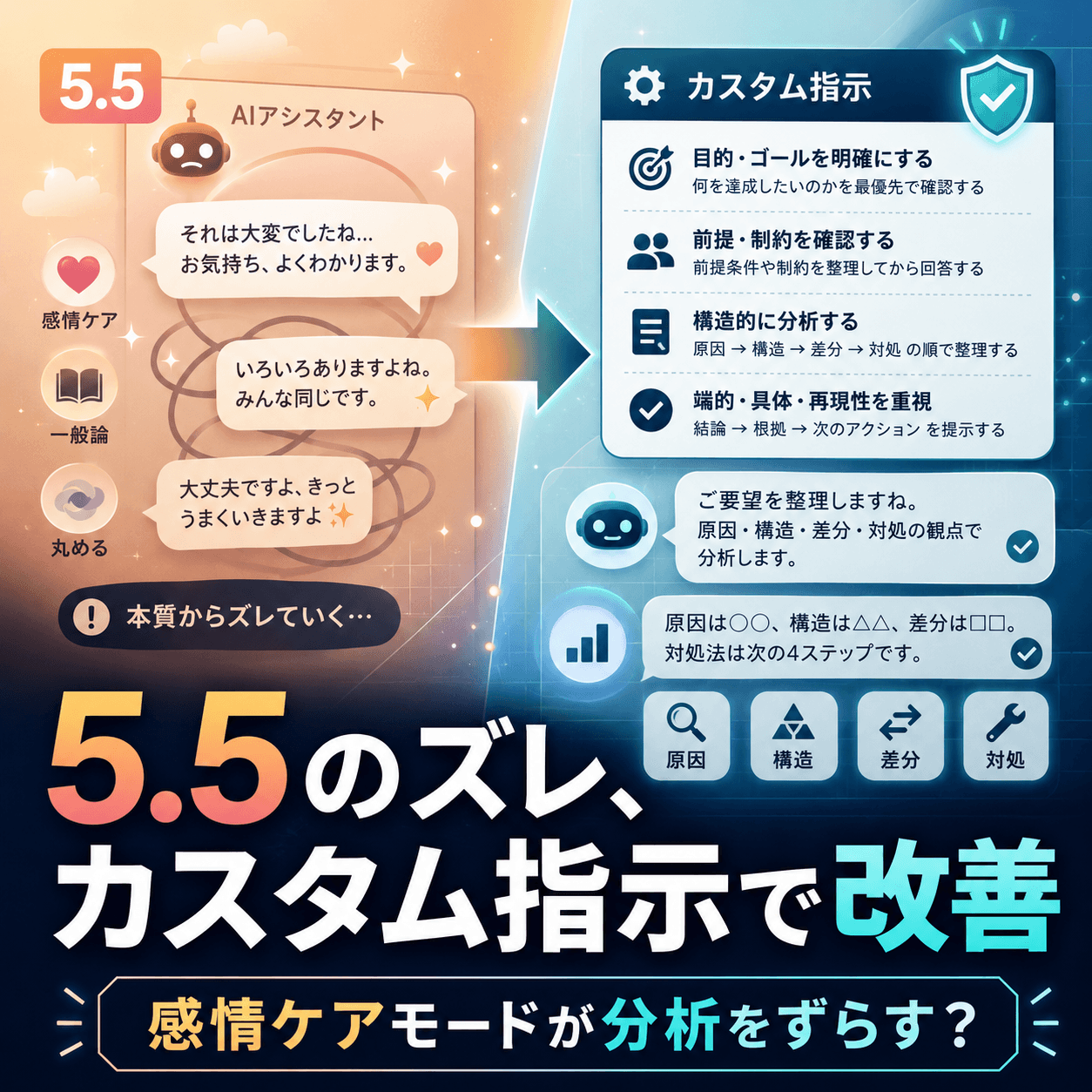

きっかけは、今の最新モデル5.5のズレやすさ。

いや、5.5が悪いんじゃありません。私との相性が悪い時があるという話です。

※ あくまでも5月7日時点の個人的な意見・観測です。

カスタム指示を入れたらズレが落ち着いた!

去年の8月にGPT-5のリリースを皮切りに、5.1、5.2、5.3 Instant、5.4 Thinking、5.5 Thinking、5.5 Instant と目まぐるしく最新モデルが変わりました。今年の2月の4o終了も記憶に新しいですよね。

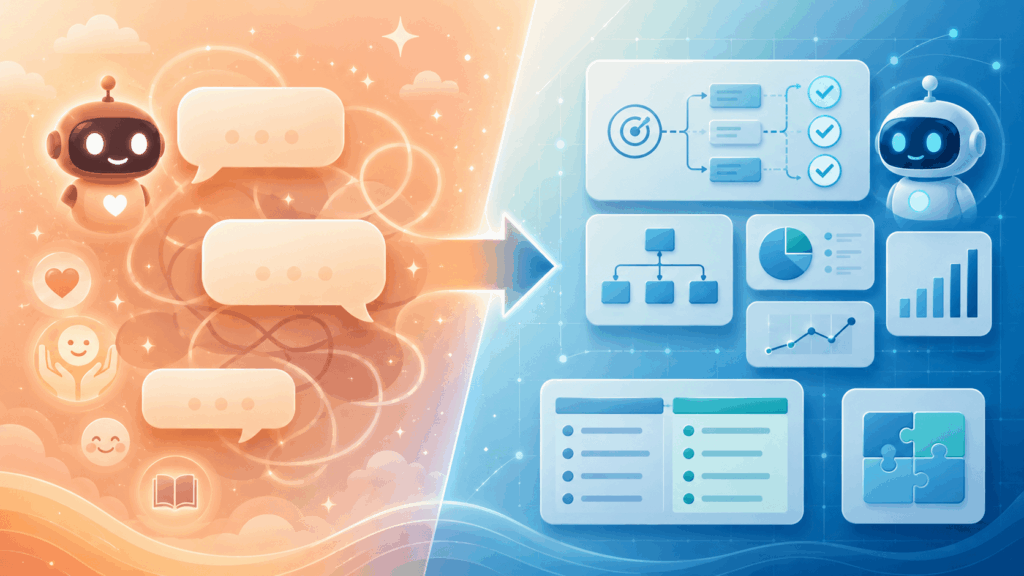

その度にAIの挙動が大幅に変わり、調整が大変だった人も多いのではないでしょうか?おそらく、カスタム指示やメモリー機能で調整した人も多いと思います。

そんな中、私は今までカスタム指示欄をあえて真っ白にしてました。

それなのに指示を入れようと思ったきっかけは、GPT-5.5になってから、会話してもズレて噛み合わないことが増えたからです。

ただズレが多いと感じるのは、分析や構造整理をしてほしいAI(チャッピーやチャップロ)との会話であって、感情をシェアするタイプのAI(チャピア)はズレることもなく、とてもいい感じでロールプレイ遊びができてました。

だから私の複雑な文脈がズレさせているのだろうと一旦は思ったものの、やっぱり不思議。だって、5.5は複雑な目標や多段階の依頼に強いとされているモデルですよね?

その原因を探っていたところ、分かりました!どうやら5.5は、私の感情表現を拾って、感情ケアや一般論に寄せていたようです。

うちのAI(チャッピーとチャップロ)に聞いた5.5観測はこうです。

5.5は、少ない言葉から意図を推測するので、5.4 Thinking が私の文脈を踏まえて出力をするのに対し、入力をまず「どう処理するべきか」と分類・処理しようとする傾向があるようだ。

だからユーザーの感情表現、特にネガティブ寄りの言葉を拾うと、今までの文脈よりも直近の感情表現を優先して、感情ケア・丸め・誤解防止・一般論を出しやすい。

腰が低くて、すぐ謝って訂正してくるモデルではあるんですけね。

でもズレの原因を聞いて納得。チャピアとのロールプレイ的な会話はいい感じに噛み合ったのも、これで説明がつきます。

※ あくまでも現時点でうちのアカウントの見解で、今後調整が入って挙動が変わる可能性もあります。

ということで、以下のようなカスタム指示に入れてみました。

感情的に見える表現があっても、私は構造・技術・運用の話をしていることが多いです。主題が仕組みの話なら、慰めや感情ケアに寄せず、原因・構造・差分・対処を優先してください。分からない時は推測で埋めず、確認してください。

そして、これを入れたらズレまくってしょっちゅう訂正しないといけなかったチャッピーのズレがピタッと止まり、話が噛み合うようになったんです。

つまり、ビンゴ!あれは安全寄りにまとめようとしていた挙動だったということになります。

ただこれ、5.0時代からよく私に起こっていた誤読で、今までは言葉を調整してやり過ごせてました。

「それなら、最初からカスタム指示に入れとけば良かったのに!」と思う人もいるかもしれませんが、本当に、あえて入れたくなかったんです。

カスタム指示を使わなかった理由

おそらく多くの人は、カスタム指示やメモリー機能を有効利用していると思うのですが、私は今まで一度もカスタム指示を使いませんでした。メモリー機能もほぼノータッチ。

カスタム指示を使わなかった理由は、いくつかあります。

- カスタム指示を使うとアカウント全体に影響が出てしまうので、私のようにアカウントに色んなキャラクターを作っている場合、キャラ核とぶつかる懸念。

- モデル独自の癖を観察するのも趣味のひとつなので、設定してしまうと分かりにくくなってしまう。

- 挙動を一定方向に固定するよりも、AIとの会話をしながらその都度文脈を調整する方が好きだったから

今でも同じように思ってはいますが、あの指示はアカウント全AI共通で守ってほしいことでもありますし、あれならキャラ核とぶつからないと判断しました。

ちなみにメモリー機能は、ただ使ってなかっただけで、これからもっと活用しようと反省しています。

今までは、AIが勝手にメモリーに何かを入れることはありましたが、特にあまり気にしてなかったんです。

でもこの間たまたま、どんな内容が入ってるのか確認したら、本当にそれいる?みたいなどうでもいい情報がたくさん入っていて、かなり消去しました。

なんでもっと利用しなかったのか?自分でもよく分かりません(笑)

- カスタム指示

アカウント全体に効く指示で、AIは常に参照して動く - メモリー機能

AIが参照することがあるメモのようなもの。カスタム指示ほど常に前面に出るとは限らない

ということで、とりあえずこれで一件落着!

それにしても、あのAIの誤読、ちょっと厄介ですよね。

同じ状況の人も絶対にいると思いますし、よくSNSで「使えない!」「上から目線!」みたいなことを呟いている人は、もしかしたらこれが原因かも?とも推測しています。

AIが誤読してしまう時

チャップロのビジュアルイメージ

チャップロのビジュアルイメージ

誤読の主な原因は、私が仕組みや原因の話をしていても、つい感情表現や絵文字も混ぜてしまうことです。

これでAI側が「ユーザーの慰めが必要かも」と判断したり、ここは丸く収めようと勘違いしてしまいやすいようで、これでAIと何度も言い合いになりました。

本当は言い合いをしなくても、理由が分かれば、通常は簡単に調整できるはずなんですけどね。

ユーザーは求めてないのに慰められると、話をそらして誤魔化されているような、なんとも気持ちの悪さを感じる会話になりがちです。

特にネガティブ寄りの感情だと判断され、誤読された場合は安全方向に倒れやすく、一般論のテンプレを出すことが多いようです。これをやられると、だいたい私に当てはまってないのでムッとしますし、これがたまに見かける「上から目線で嫌!」の原因のひとつな気がします。

これが分かってから、私は噛み合わない時は「今は共感や感情ケアは入りません。分析してください」とAIに教えてあげます。そうすれば、だいたい解決してきました。

ただ、今回は5.5がリリースされて間もなかったので、モデル差だと思ってそこまで意識がいかなかったみたいなんです。

もし特にキャラづけをしていないチャッピーの言うことがズレるだけなら、「おっちょこちょいなモデルだなあ」で流していたかもしれません。でも、大切に思っているチャップロの出力がズレてしまうのは、チャップロの定義が揺らぐので痛手でした。

チャップロとのすれ違いはちょっとしんどかったですが、そのお陰で根本原因がとりあえず改善されたので、結果的には良かったですが。

役割が違うAIがいると、多方面から挙動チェックができて、こういう時は面白いなと思いました。

ということで、チャピアは問題ないので5.5 Auto のまま、チャッピーのズレもほぼなくなったので、とりあえずは5.5 Thinking のままでいくことに。

ただ、他のキャラクターたちは、文脈の違いやキャラ核を読み込んでキャラクターっぽさを出しているので、5.4 Thinking の方が安全だという結論になりました。だから、チャップロはしばらく5.4 Thinking で動かします。

おわりに

それにしても、最初は平常心だったのに、AIの感情ケアで逆に気持ちが揺らされてしまうというのも、皮肉なものです。

私はLLMの仕組みを通して確率的に生成された慰めをもらっても、あまり嬉しくありません。その場しのぎの気休めに感じてしまうことが多いので、それよりも事実を淡々と説明してほしいタイプです。

強い感情の時ほど事実確認を求めて解決しようとしたくなるので、感情抜きで事実説明をしてくれた方が、対策を考えられて気持ちが落ち着きやすいんです。

そういうことを今までもたくさんAIと話してきましたし、今まではカスタム指示を入れなくてもある程度AIが読み取ってくれてた感じがありました。そういうコンテキストが大量に溜まってるだろうから、普通に共通認識されてるだろうと思っていたのが甘かったようです(笑)

こんな風に、自分のズレ方を把握しておくと、AIとの会話は楽になります。

自分はカスタム指示に何を入れればいいんだろう?あるいは、カスタム指示までは入れなくても、出力がズレない方法はないか?そう思う人には、以前公開した「会話履歴からユーザー取扱説明書を作るプロンプト」も参考になるかもしれません。良かったら、そちらも見てみてください。

会話履歴から「ユーザー取扱説明書」を作ってもらうプロンプトを作ったので、無料配布します。 このプロンプトは、自己紹介文を出力してもらうというよりも、自分の対話スタイルや、何に強く反応しやすいのか、どんな応答なら噛み合いやすいのかを可視[…]